Ha a bűnmegelőzés vagy bűnüldözés kontextusában gondolunk a mesterséges intelligenciára, valószínűleg sokaknak először a Különvélemény (Minority Report) című film jut eszébe, amelyben egy olyan rendszer segíti Tom Cruise-t és rendfenntartó kollégáit, amely előre megmondja, hogy ki, mikor, hol és milyen bűncselekményt fog elkövetni. De mennyi ebből a valóság, mennyire állunk ehhez közel az AI-tehcnológia jelenlegi állapota szerint?

Egyelőre a felderítésben segít a legtöbbet

Természetesen ettől még nagyon messze vagyunk, de tény, hogy az új technológiák sok mindent lehetővé tesznek. Ahhoz azonban, hogy megértsük, hogy miben lehet segítségünkre az AI a bűnmegelőzésben, látni és érteni kell, hogy mi a prevenció – nyilatkozta az Economxnak Molnár István Jenő. A bűnmegelőzési szakértő szerint bűnmegelőzésnek minősül minden olyan intézkedés, beavatkozás, amelynek célja a bűncselekmények számának csökkentése, elkövetésének megakadályozása, illetve az áldozattá, továbbá az elkövetővé válás esélyének minimalizálása.

„Vannak szakértők, köztük magam is, akik ehhez hozzá szokták fűzni azt is, hogy a megelőzés körébe tartozik a szubjektív biztonságérzet növelése is, azaz bizonyos prevenciós intézkedések célja az, hogy sem veszélyesebbnek, sem biztonságosabbnak ne mutassuk a körülöttünk lévő offline és online teret, mint amilyen az valójában” – tette hozzá.

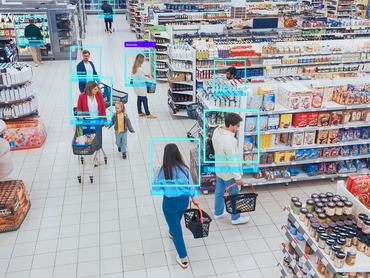

Ha az iménti definíciót vesszük alapul, akkor jól látható, hogy a mesterséges intelligenciához leggyakrabban társított funkciók, úgy mint arcfelismerés, big data elemzések, különféle azonosítások (például rendszámfelismerés) sokkal inkább a felderítést, tehát a már elkövetett bűncselekmény elkövetőjének felkutatását segítik, semmint a megelőzést. Molnár István Jenő hangsúlyozza, hogy a bűncselekményi triász (elkövető-áldozat-helyszín) elemei közül a klasszikus értelemben vett bűnmegelőzés során elsősorban az áldozatnak tudnak segíteni.

Neki ugyanis érdeke, hogy ne váljon azzá, ezért, ha támogatjuk, akkor képes lehet elkerülni a csapdákat. Az AI tehát a jövőben elsősorban leginkább abban segíthet, hogy képessé tegye az áldozatot bizonyos cselekmények, elsősorban vagyon elleni támadások felismerésére.

Tízpercenként próbálkoznak csalással

Ma már millió féle módon próbálnak tőlünk pénzt és később pénzzé váltható adatot kicsalni. Ilyen például a hamis banki sms (smishing), a hamis szolgáltatói ügyintézés (angler phising), a hívószám-hamisítások (spoofing), a visszahívásos telefonos csalások (wangiri), vagy éppen a hamis banki telefonhívások (vishing) – sorolja a pénzügyi csalások formáit a szakértő.

„Elképzelhetőnek, sőt szükségesnek tartom, hogy idővel megjelenjenek olyan szoftverek, amelyek képesek a potenciális áldozat figyelmét felhívni arra, hogy az sms, telefonhívás, e-mail valószínűsíthetően illetéktelen személytől érkezik”

– közölte Molnár István Jenő.

Ez olyannyira nem jövőbeli igény, hogy Magyarországon – szinte egyedülálló módon a világon –, 2025. július 1-jétől, a Központi Visszaélésszűrő Rendszerben (KVR) egy utalás esetében, aminek az Azonnali Fizetési Rendszerben, EU-s előírások alapján is 5 másodpercen belül meg kell érkeznie a másik félhez, egy olyan – mesterséges intelligencia által végzett – folyamatzajlik le, ami képes ebben a rövid időintervallumban is a másodperc tört része alatt észlelni, ha a másik fél kiléte gyanús. Például azért, mert mondjuk semmilyen módon nem kapcsolódik a számlatulajdonoshoz, vagy mert a fogadó bankszámlaszám korábban már volt gyanús ügyletekhez köthető.

Az elmúlt évek egyértelmű tendenciája, hogy az elkövetett bűncselekmények jelképes tortájából amúgy is a legnagyobb szeletet jelentő vagyon elleni bűncselekmények jelentős része az offline térből áthelyeződött az online térbe.

„Magyarországon a kiberbűnözők naponta átlagosan 10 percenként próbálkoznak egy átutalásos csalással, s körülbelül egy lakás árát (70-75 millió forint) csalják ki az áldozataiktól, legtöbbször az áldozatok figyelmetlenségét vagy jóhiszeműségét kihasználva”

– sorolta a sokkoló tényeket a szakértő. Meglátása szerint elsősorban itt segíthet a mesterséges intelligencia. Jó hír, hogy az elmúlt évek kibervédelmi intézkedései és kampányai hatására, továbbá az emberek saját kárán való tanulásának is köszönhetően, míg 2021-ben a csalások sikerességi aránya 80 százalék körül mozgott, addig ma már csak 35-40 százalék. Ráadásul az eltulajdonítani kívánt összegnek idén már csak 56 százalékát tudták megszerezni, szemben a korábbi közel 85 százalékos mutatóval.

Már most van lehetőség a deepfake-t kiszűrni

A pénzügyi csalásokon felül erőszakos cselekmények kapcsán is hasznos lehet az AI, hiszen ma már egy-egy alkalmazás képes például a közösségi médiában megjelenő posztok alapján kiszűrni az erőszakos megnyilvánulásokat, önsértő tendenciákat vagy radikalizálódást, így lehetőséget ad a hatóságoknak a korai beavatkozásra – mondta Molnár István Jenő. Idővel talán arra is figyelmezteti majd a felhasználókat egy-egy rendszer, hogy az adott tartalom, videó fakenews vagy deepfake gyanús. Ma még csak a tudatos felhasználókat segíti ilyen rendszer, mint például a Norton Deepfake Protection vagy a McAffee Deepfake Detector, amit külön kell letölteni, megvásárolni, s lefuttatni rajta a kérdéses tartalmat. Erre pont azért lenne szükség, mert

sokszor a média erőszakosabbnak, brutálisabbnak mutatja a világot, mint amilyen. Ha pedig ezeket valaki kételkedés nélkül elhiszi, akkor csökkenhet a korábban definíció-elemként említett szubjektív biztonságérzet.

Szingapúrban a rendőrség egy olyan rendszert is tesztelt, amely kamerák és szenzorok segítségével az utcán mozgó emberek viselkedését elemzi, és riaszt, ha valaki például nyilvánosan dohányzik, vagy szabálytalanul parkol. Persze, teljes joggal kapcsol be többünknél ilyenkor a piros lámpa. Igen, ami előny, az hátrány is lehet. Az AI önmagában se nem jó, se nem rossz, a kérdés, hogy kik, mire és hogyan használják fel – hangsúlyozta. Pozitív ellenpéldaként említette, hogy a londoni King’s Cross pályaudvaron például már évekkel ezelőtt tesztelték az automatikus mozgáselemző rendszert, amely jelezte, ha valaki szokatlan módon viselkedett vagy gyanús csomagot hagyott hátra.

Nem lehet kivenni az embert a rendszerből

Hiába alkalmazzuk azonban egyre több területen a gépi elemzést, a gépek is tévedhetnek. Erre a szakértő azt reagálta, hogy

a legalább időszakos emberi felügyelet nem szüntethető meg.

Az egyik legismertebb probléma például az algoritmikus torzítás: az AI gyakran a múltbeli adatok alapján tanul, amelyek maguk is torzítottak lehetnek. Ennek következménye, hogy a rendszerek hajlamosak bizonyos társadalmi csoportokat – például etnikai kisebbségeket vagy szegényebb rétegeket – aránytalanul nagyobb kockázatúnak feltüntetni. Egy 2020-as amerikai esetben egy detroiti afroamerikai férfit arcfelismerés alapján tartóztattak le, holott semmi köze nem volt a bűncselekményhez. Az algoritmus egyszerűen összetévesztette valaki mással, mégis órákig tartották fogva a rendőrségen.

Molnár István Jenő szerint komoly kritikák születnek a prediktív rendészet területén is. Régebben, amikor manuálisan végezték ezt a rendőrök, akkor a statisztikai adatok értékelésével-elemzésével hotspotokat jelöltek ki, ami csupán annyit jelentett, hogy a múlt tapasztalatai alapján az adott területre nagyobb erőket koncentráltak. Ebben olyan nagy veszély nem volt, legfeljebb más területen csökkent a rendőri jelenlét, amit esetleg egy szemfüles elkövető ki tudott használni. Elsősorban az USA-ban azonban próbálkoztak AI alapú jóslásokkal, de egyelőre több a kritika, mint az elégedett hang, nemcsak a pontosság, de a jogi-diszkriminációs hibák tekintetében is.

Megfigyelés vs jogállamiság

Adja magát a kérdés: hol húzódik a határ a megelőzés és/vagy megfigyelés között? Sérülhet-e ezzel a személyiségi jog vagy maga a jogállamiság?

A szakértő emlékeztetett, egy világ látta nemrég, amikor a Coldplay koncertjén a "Kiss Cam" lebuktatott egy vezérigazgatót és a beosztottját.

Nemcsak mémmé váltak, de a jelenet megmutatása valós hatást gyakorolt az életükre. Őket most megfigyelték vagy sem?

Mi a nagyobb társadalmi érdek? Az, hogy miközben pásztázzuk a tömeget, ilyen személyes, alapvetően senki másra nem tartozó szenzitív adatok ne jussanak a birtokunkba, vagy hogy akár csak egyszer is kiszúrjuk azt az autót, aki a tömegbe kíván hajtani?

Elsősorban jogi garanciák kellenek, amik a kontinensünkön többnyire adottak. Az Európai Unió új mesterséges intelligencia rendelete, az AI Act (2024) világosan kimondja, hogy a valós idejű biometrikus azonosítás közterületen alapvetően tilos, kivéve különösen súlyos bűncselekmények esetén, és csak bírói engedéllyel. Kockázatalapú megközelítést vár el az AI készítőitől és használóitól, s taxatív módon meghatározza, hogy mi minősül elfogadhatatlan kockázatnak és tiltott MI gyakorlatnak. A teljesség igénye nélkül ide tartozik minden manipulációra alkalmas fejlesztés, a társadalmi pontozást végző szoftver használata, amelyet Kínában előszeretettel alkalmaznak, az érzelemfelismerés a munkahelyen, de a bűnügyi előrejelzést végző alkalmazások bevetése is.

Molnár Jenő István szerint hazánkban hallhattunk néhány esetben – bűnügy, rendezvény kapcsán – AI használatáról, elsősorban arcfelismerési célzattal, de ma itthon talán leginkább az OSINT technika révén férkőzött be az AI a nyomozói munkába. Az OSINT (Open Source Intelligence = nyílt forrású hírszerzés) tulajdonképpen bárki által végezhető, hiszen nyílt forrásokból táplálkozik a módszer. Ilyen nyílt forrásnak minősülnek a közösségi média platformok, a blogok, videók, adatbázisok, s természetesen az átlag ember által soha nem, de a bűnözői életmódot folytatók által gyakran használt darkweb és deepnet tartalmak is. Kiemeli, hogy egyértelműen a fajsúlyosabb, elsősorban élet elleni és a szervezett bűnözéshez kapcsolható bűncselekmények kapcsán használják a nyomozók.

Mire számítsunk a jövőben?

„Egyrészről a jövőben a banki szolgáltatások során felmerülő csalások kivédése válik nagyon fontossá, hiszen ahogy korábban is írtam, óriási károkat okoztak a csalók. Látjuk, hogy az edukáció és a figyelemfelhívás önmagában nem elegendő, egyszerűen a felhasználók sok esetben túl naivak, figyelmetlenek, ezért nagyon fontos lenne, hogy külső védelmet kapjanak” – hangsúlyozta a szakértő. Ezen túlmenően jelenleg is zajlanak az állami infrastruktúrákat védő rendszerekre irányuló fejlesztések, hiszen egyre több adatunk kerül át az online térbe, az ügyintézések többsége is lassan Ügyfélkapu+-on vagy DÁP-on keresztül történik, ahol most már nemcsak adatok, de sokszor pénzmozgások is vannak.

Molnár István Jenő azt is elmondta, hogy a börtönök is célponttá váltak az elmúlt időszakban, sokat hallhattunk a csengeri „okosbörtönről”, ahol zárak és kulcsok nélkül, arcfelismerő rendszerrel működő létesítményt alakítottak ki. Több olyan kezdeményezés is van már, amelyek olyan AI alapú rendszerek kifejlesztését szolgálják, amelyek képesek felismerni a viselkedésből, hangszín-változásból az esetleges konfliktust.

Egyelőre tehát ne várjunk olyan csodát, mint amit a Különvélemény című filmben láthattunk, de az biztos, hogy az online csalóknak egyre nehezebb dolga lesz, amikor megcélozzák vagyonunkat, adatainkat.